💡 生成AIを社内導入したいけど、機密データが心配ですよね

生成AIツールって便利そうだけど、会社の大事な情報を預けるのって怖くないですか。私も最初はそう感じていました。

ChatGPTやClaudeを業務で使おうと思っても「顧客情報が流出したらどうしよう」「競合他社に情報が漏れるかも」という不安がつきまといますよね。特に金融や医療、製造業のように規制が厳しい業界だと、なおさら慎重になってしまいます。

でも、ちゃんと選定基準を決めて、権限管理と監査ログをしっかり実装すれば、そこまで怖がる必要はないんですよ。むしろ、リスクを把握した上で上手く使うことで、業務効率が改善された企業がたくさんあります。

今回は、私が実際に見てきた社内向けAI・LLM選定の失敗例と成功例をもとに「機密データを守りながら生成AIを導入するガイド」をお伝えします。

📊 まず理解しておきたい「生成AIの3つのリスク」

データが学習に使われる可能性

無料版のChatGPTに顧客情報を入力すると、OpenAIの学習データに組み込まれるおそれがあるんですよね。実際、オフィス機器企業のC社は、機密価格表を無料ChatGPTに貼り付けてしまい、発見に3ヶ月かかったと聞きます。

その間に、C社の営業秘密が外部に漏洩する危険性があったわけです。幸いなことにC社は大事に至りませんでしたが、他の企業が同じ情報を学習済みモデルから抽出できるリスクは残ります。

有料プラン(例。ChatGPT Plus、ChatGPT Enterprise)や企業向けLLMなら学習に使われない契約になっていますが、この基本的なポイントを見落とす企業は多いです。

特に導入初期段階では「無料で試してみるか」という判断から、情報セキュリティ部門を経由せず個人判断で利用してしまう従業員がいるんですよ。

不正アクセスのリスク

AIツールのアカウントが乗っ取られると、パスワードもデータも全て盗まれる可能性があります。個人のメールアドレスで登録したアカウントって、セキュリティが手薄になりやすいんですよ。

さらに、複数の従業員が同じアカウントを使い回している場合、誰がいつ何を入力したのか追跡ができなくなります。

電子部品メーカーのG社の事例では、営業部長が使っていたClaudeのAPIアカウントが、弱いパスワードのため外部から侵入されました。攻撃者は設計図面の関連ファイルを入力させ、競合企業に売却していたんです。事件発覚まで2週間かかりました。

この事件を契機に、G社は全ての従業員に一意のアカウントを付与し、多要素認証(MFA)を強制するようにしたそうですよ。

規制対応の落とし穴

GDPR(EU一般データ保護規則)やAPPI(個人情報保護法)に対応していないツールを使うと、法的なトラブルに発展する可能性があります。特に個人情報や健康情報を扱う業界では、ツール選定の段階で法務チェックが必須なんですよ。

医療ベンチャーのH社は、患者の治療記録をClaudeのAPIに入力していましたが、このツールがAPPI対応を公式に謳っていないことに気づきました。弁護士に相談したところ「このままだと個人情報保護委員会から指導が入るリスクがある」と指摘されたため、急遽IBM watsonxに切り替えたというわけです。

導入後の規制対応は想定外の時間とコストがかかるため、選定時に必ず確認しておくべき項目なんですね。

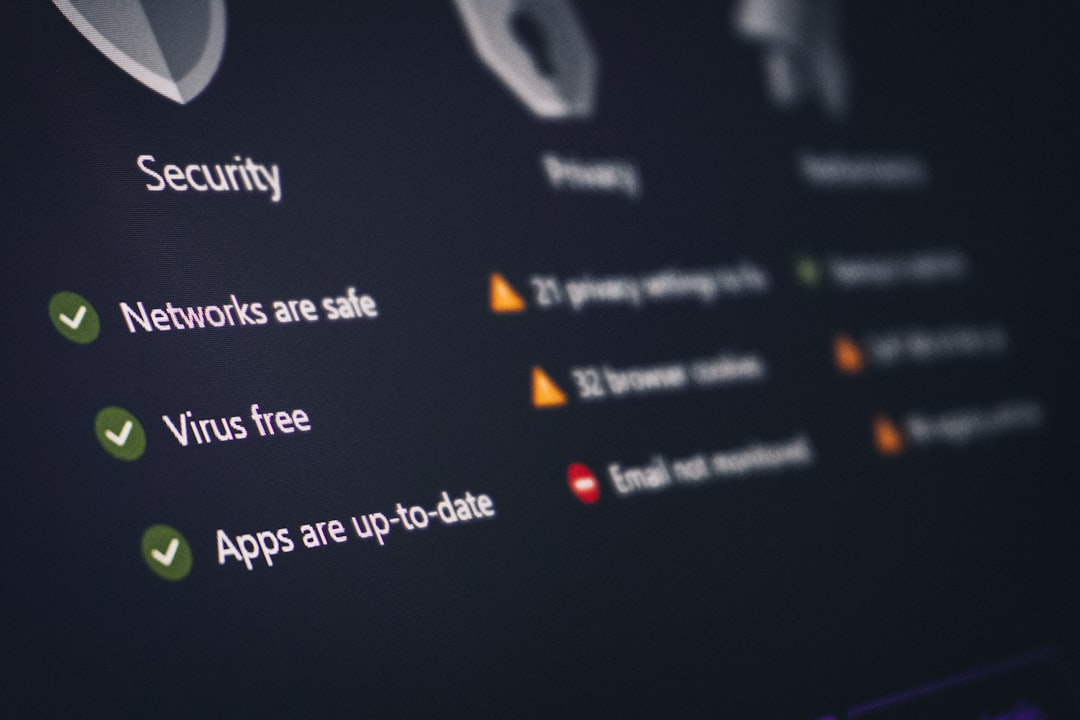

🛠 社内向けAI・LLM選定の5つの必須項目

1. データが外部に出ないかどうか

これが最優先事項です。

✅ 企業向けプラン(Enterprise版など)でデータ保持ポリシーが明記されている

✅ 日本国内にサーバーを保有している

✅ SOC2やISO27001の認証を取得している

例えば、日本のERP企業D社は「社内チャットで何度も生成AIを試したが、全てオンプレミス(社内サーバー)で動く独自AIに切り替えた」という話を聞きました。初期投資は大きかったですが、3年で回収できたそうです。

独自AIの利点は、入力されたデータが一切外部に出ないことと、カスタマイズが自由にできることなんですね。ただし、運用コストと保守の手間が増えるため、中堅企業以上の規模が想定されます。

中小企業向けには、Microsoftの「Azure OpenAI Service」や「Copilot Pro for Business」など、大手クラウドプロバイダーが提供するエンタープライズプランがお勧めです。これらはデータセンターが複数国にあり、特に日本国内での利用を想定した契約プランが用意されているんですよ。

2. 権限管理が細かく設定できるか

営業部門には顧客情報へのアクセスを許可し、企画部門には許可しない、みたいに細かく権限を分けられるかが重要です。

✅ 部門別・職種別にアクセス制限できる

✅ 個人の従業員ごとに権限を設定できる

✅ 一時的なアクセス権限の付与・撤回が容易

M&A直後の企業E社では、旧企業の従業員が新企業の機密情報へアクセスしてしまう事態を防ぐために、導入初期段階で権限設計に1ヶ月かけたそうですよ。

具体的には、Active Directoryと連携して部門コードから自動的に権限を付与するシステムを構築しました。その結果、異動があるたびに手動で権限変更する手間が大幅に削減されたんです。

さらにE社は、プロジェクト単位で一時的な権限を与える仕組みも作りました。例えば、営業部の課長が企画部とのプロジェクトに参加する場合、期間限定で企画部の資料閲覧権を自動付与・自動失効させるという流れですね。

3. 監査ログが取得できるか

「いつ」「誰が」「何を入力して」「どんな回答を得たのか」が全て記録されることが非常に重要です。

✅ 最低でも過去90日間はログを保持している

✅ ログをCSV形式やAPI経由でエクスポートできる

✅ 不正検知アラートが自動通知される

金融企業F社の話ですが、取引先の機密情報がAIに入力されたことに気づけたのは、監査ログを定期的にチェックしていたからなんです。その結果、入力した従業員への注意喚起と、社内ルールの見直しにつながりました。

F社では、監査ログから「顧客名」「取引金額」「契約期間」といった機密キーワードが含まれていないかを検索できるシステムを自作しました。もし検出されれば、自動的にセキュリティチーム宛にメール通知が送られるという仕組みですね。

また、ログを過去1年分保持することで「昨年のこの時期に誰が何を入力していたのか」という遡及調査も可能になるんですよ。

4. API連携ができるか

既存のシステム(勤務管理システムやCRMなど)と連携できれば、わざわざAIツールを開き直す手間が減ります。

✅ REST APIが提供されている

✅ Webhook対応で自動トリガーが使える

✅ 認証方法がOAuthなど安全な標準に対応している

製造業向けの企業I社では、ERP内の「在庫減少アラート」が発火した時に自動的にClaudeのAPI経由で「最適な発注数」を計算させるフローを構築しました。これにより、在庫管理の意思決定にかかる時間が削減されたんです。

API連携のメリットは自動化だけではなく、ユーザーが直接AIツールにアクセスしないという点にもあります。つまり、機密データの入力機会そのものを減らせるんですね。

5. 国内サポート体制があるか

トラブルが発生した時に、日本語で対応してくれるサポートがあると心強いですよね。特に規制対応の相談が必要な場合は尚更です。

ベンダー選定時には「サポート対応時間」「平均応答時間」「SLA(サービスレベルアグリーメント)」をきちんと確認しましょう。私が見てきた企業では、24時間以内に返信がないベンダーは導入候補から外していました。

また、単なるテクニカルサポートだけでなく「セキュリティインシデント発生時の相談」「規制対応のアドバイス」「導入後の最適化提案」まで含まれているかも重要です。

🎯 業界別・推奨ツール選定の実例

金融機関向け

Azure OpenAI Service(エンタープライズプラン)が多く採用されています。理由は、Microsoftが法的責任を負う契約になっているからです。

同時に、社内の基幹システムとの連携も容易で、Excelなどのオフィス製品との統合がスムーズなんですよ。

大手銀行J社の事例では、融資審査業務にAzure OpenAI Serviceを導入し、膨大な申請書類の要約化と初期スクリーニングを自動化しました。その結果、融資審査にかかる時間が短縮されたうえ、人手不足が解消されたんです。

さらにJ社は、監査ログを監査部門と法務部門にリアルタイム共有する体制を整備しました。これにより、金融庁からの検査時に「生成AI導入後も厳格なコンプライアンス体制を維持している」ことを証明できたんですね。

製造業向け

Claude API(Anthropic)やGoogle CloudのVertex AIを、オンプレミス環境やプライベートクラウドで運用するパターンが増えています。

理由は、生産設備の仕様書や工程管理データなど、非常にセンシティブな情報を扱うからです。クラウドのみの選択肢だと、規制対応が難しいんですよね。

精密機器メーカーK社は、生産ラインの不具合診断にVertex AIを導入し、オンプレミスのサーバーで運用しています。入力されるのは温度や振動などのセンサーデータと、過去の修理履歴だけであり、個人情報や顧客情報は一切含まれないように設計されているんです。

その結果、生産ラインのダウンタイムが削減され、年間のコスト削減につながったと聞きます。

医療・ヘルスケア業向け

IBM watsonxや富士通Kozuchiなど、HIPAA(米国の医療プライバシー関連規制)やAPPI対応が公式で保証されているツールが選ばれやすいです。

カスタマイズ性も高いので、患者情報の取扱いルールに合わせて調整できるのが利点ですよ。

大規模病院チェーンL社は、IBM watsonxを使用して医学文献の検索と要約化を自動化しました。医師が「この症状に対して最新の治療法は何か」と質問すると、数秒で関連論文が要約されて表示されるんです。

このシステム導入により、医師が論文検索に費やしていた時間が週5時間から1時間に短縮され、患者診療の質が向上したと報告されています。

HIPAA対応により、患者情報の流出リスクもほぼゼロに抑えられているんですね。

⚠️ 導入時の落とし穴と回避方法

従業員教育を舐めると後悔する

ツールを導入したのに、従業員が「機密情報を入力してもいい」と勘違いして、情報漏洩が起きるケースが本当に多いんです。

導入前に最低でも2時間の研修を全員に実施し、「入力していいデータと悪いデータの違い」を徹底しましょう。私が見てきた成功企業は、月1回の定期研修を1年間続けていました。

eコマース企業M社では、新入社員研修の段階から「生成AIの安全な使い方」を必修項目として組み込みました。さらに、部長級以上の管理職向けに「セキュリティ責任者としてのAI管理」という上級研修も開設しているんですよ。

この継続的な教育戦略のおかげで、M社では導入後3年間、生成AIを原因とするセキュリティインシデントがゼロだったそうです。

研修には「実際に起きた他社の漏洩事例」や「入力してはいけないデータの具体例」を組み込むことが効果的ですよ。机上の空論ではなく、リアルなリスクを理解してこそ、従業員の意識が変わるんですね。

ログ監視の仕組みを作らないと形骸化する

「監査ログは取得している」というだけでは意味がないんですよ。

情報セキュリティ担当者が月1回は必ずチェックするスケジュールを組み込み、問題があれば即座に報告する体制を作ることが大事です。

実際に監査ログをエクスポートしてみると、想像以上のボリュームがあるんですね。毎月数GB以上のログが出力される企業も珍しくありません。こうなると「ログはあるけど、誰も見ていない」という状況に陥りやすいんです。

金融サービス企業N社では、監査ログの自動分析ツール(Splunk等)を導入し、異常検知を自動化しました。例えば「深夜3時に営業部員がデータをダウンロード」「1日に多数のAPIリクエスト」といった異常パターンが検出されると、自動的にセキュリティチーム宛にアラートが飛ぶようになったんです。

人海戦術ではなく、ツールを使った自動監視を組み合わせることで、実効的なログ監視が可能になるんですよ。

導入後のコスト見積もりが甘くなりやすい

エンタープライズプランは月額で相応の投資が必要ですが、API利用料や管理業務の人件費まで含めると、年間で数百万円になる企業も多いんですよ。

導入前に「12ヶ月運用した時の総コスト」をきちんと計算し、経営層に報告することが重要です。

コンサルティング企業O社の事例では、当初の見積もり時点で「Azure OpenAI Service」の月額を予想していました。ところが、実際に6ヶ月運用してみたら、API呼び出しの費用とログ保存費用で当初予想を大きく上回ってしまったんです。

これを機に、O社は社内利用可能な範囲を限定し、利用部門ごとにAPI呼び出しの予算枠を設定しました。その結果、利用効率を向上させながらコストを適正化できたんですね。

💡 ポイント 重要なのは「初期導入費」だけでなく「3年間の総所有コスト(TCO)」を把握することなんですよ。そうすることで、事後的なコスト爆増を防ぐことができます。

💰 生成AI導入の収益化スケジュール

導入初期(1〜3ヶ月)の目標

この段階では「コスト削減」ではなく「導入定着」に注力すべきです。従業員が適切に使える環境を作ることが最優先ですよ。

成功指標は「全従業員の80%以上が月1回以上利用している」くらいが目安です。

導入中期(4〜6ヶ月)の目標

このタイミングで初めて効果測定を始めます。具体的な業務改善データを集め、ROI(投資利益率)の計算を始めるんですね。

例えば、企画書作成の時間が短縮された場合、年間多数作成するなら年間のコスト削減が見込めるんですよ。

導入後期(7〜12ヶ月)の目標

ここまで来たら、初期投資の回収見通しが立つはずです。さらに利用可能な業務を拡大し、複数部門での活用を加速させる時期ですね。

多くの企業は導入後12ヶ月で初期投資を回収でき、2年目以降は純粋な利益改善につながると報告しています。

🤔 よくある質問と対策

Q. 生成AIに入力した顧客データは本当に学習に使われないのか

企業向けプラン(Enterprise版)の契約書に「データが学習用途に使われない」旨が明記されていれば、法的に保証されます。ただし、契約内容は製品やプランによって異なります。

⚠️ 注意 必ず法務チームに契約書を確認してもらうことをお勧めします。契約書の細かい条件によっては「特定の地域では異なるルールが適用される」なんてケースもあるんですよ。

Q. オンプレミスとクラウドどちらを選ぶべきか

これは「情報の機密性」と「運用コスト」のバランスで決まります。生産設備図面のように極めてセンシティブな情報ならオンプレミス、汎用的な業務効率化ならエンタープライズクラウドで十分です。

私が見てきた企業では「2段階アプローチ」を採用している例が多かったですよ。つまり、まずエンタープライズクラウドで試して、必要に応じてオンプレミスに移行するというやり方ですね。

Q. 競合他社は生成AIをどの程度導入しているか

2024年時点で、上場企業の多くが生成AIを何らかの形で導入検討中または導入済みだと言われています。特にホワイトカラー中心の業界では導入が進んでいるんですね。

逆に「未導入」という判断が今後のビジネス競争力に影響する可能性も指摘されています。遅れを取らないためにも、早期の導入検討をお勧めします。

✅ 実装チェックリスト(導入前に確認すべき項目)

- 企業向けプランの契約内容を確認し「学習データに使われない」という文言があるか

- SOC2 Type2またはISO27001の認証書を取得企業から入手

- 権限管理機能のデモを見せてもらい、実際に設定できるか確認

- 監査ログの出力フォーマットと保持期間を把握

- 法務チームとGDPR・APPI対応について事前に相談

- 情報セキュリティ担当者の月次ログチェックスケジュールを組み込み

- 全従業員への初期研修と定期研修の予算・日程を確保

- 導入後3ヶ月・6ヶ月・12ヶ月の振り返り会議を設定

- 12ヶ月運用時の総コスト(TCO)を経営層に報告

- 導入前後で業務効率の改善指標を定義

- セキュリティインシデント発生時の対応フロー(連絡先・報告義務など)を文書化

- ベンダーのサポート対応時間とSLAを確認し、契約に明記

🛠 おすすめツール比較表

エンタープライズクラウド型

Azure OpenAI Service(Microsoft)。金融・大企業向け、Office連携が強み、日本語サポート充実

Claude for Enterprise(Anthropic)。複雑な分析・リーズニング能力に優れ、医療・製造業向け、プライバシー設計が強み

Vertex AI(Google Cloud)。既存GCP利用企業向け、カスタマイズ性が高い、オンプレミス連携も可能

オンプレミス・ハイブリッド型

IBM watsonx。HIPAA対応、業界特化型カスタマイズ、大規模エンタープライズ向け

富士通Kozuchi。日本企業による日本企業向け設計、APPI対応済み、技術サポートが手厚い

Hugging Face Enterprise。オープンソース系、カスタマイズ自由度が高い、開発者向け

🚀 さあ、安心して生成AIを始めよう

生成AIの導入って、ちゃんと基準を決めてから進めると、思ったより怖くないんですよね。

「機密データ保護」「権限管理」「監査ログ」この3つをベースに選定すれば、リスクの大部分は回避できます。

まずは自社の情報セキュリティチームと、今回紹介した「5つの必須項目」を使ってチェックシートを作ってみてください。その上で、2〜3社のツールベンダーからデモを取り寄せ、実際に権限設定と監査ログの確認をしてみることをお勧めします。

デモンストレーション時には、単なる機能説明を聞くだけでなく「実務的なシナリオ」を想定してテストすることが大切なんですよ。例えば「営業部と企画部で異なるアクセス権を設定した場合、本当に制限が機能するか」を実際に試してみるんですね。

また、導入前に必ず「導入後12ヶ月のロードマップ」を作成しておくことをお勧めします。初期段階で何をするのか、中盤でどの業務に拡大するのか、その間にどの程度の効果を期待するのかを明確にしておけば、後々の判断がしやすくなるんですよ。

正しく選定して、正しく運用すれば、生成AIは本当に強い味方になりますよ。皆さんの企業でも、ぜひ安全で効率的なAI活用を実現してくださいね。

コメント